当人工智能(AI)加速芯片已成为大型科技公司标配后,老牌科技公司IBM亦给出回应。在本周举行的芯片行业会议HotChips上,IBM正式公布新款处理器“Telum”,Telum是IBM首款具有芯片上AI加速功能的处理器,用于IBM下一代Z系列大型机和LinuxONE服务器。

IBM Telum包含8个处理器核心,频率超过5GHz,每个核都由重新设计的32MB专用2级缓存支持。该处理器采用三星7纳米制程工艺,并且单芯片内采用17层金属连接,来完成高密度电路互连,总线长可达约30公里。

为了支持AI加速处理性能,新处理器面积为530平方毫米,集成多达225亿个晶体管,并拥有全新的分支预测、缓存,支持多芯片一致性互连,性能提升超过40%。

此外,IBM Z Telum处理器还采用双向环形互连拓扑结构,带宽接近320GB/s。三级缓存所有核心共享,通过二级缓存与核心相连,平均延迟达到12纳秒(1纳秒等于10的负9次方秒)。

IBM称,新处理器通过芯片内深度学习推理(Inference) ,帮助即时解决金融客户解决欺诈等问题,从而不需要将数据转移至芯片外。AI计算大致分为两个层面,首先是对模型进行训练(training),整个过程可能耗时数天或数周;之后是训练出的模型做出推理。

实际上,在芯片内集成和加强AI能力,IBM与英特尔思路一致,两者均强调增强芯片的AI计算能力作为卖点。例如英特尔推出的第三代至强服务器芯片,在深度学习方面增加了最新深度学习加速指令集,提高AI处理速度和模型计算精度。

IBM称,其人工智能硬件研究中心花了3年的时间研发打造出Telum处理器。打造出第一款结合AI加速推论功能的处理器芯片,用于大型机上时,可以协助银行解决诈骗、高频交易等金融难,预计2022年上半年采用该芯片的大型机系统将会推出。

IBM介绍,金融企业可以将训练完的AI或深度学习模型打包,到采用Telum处理器的IBM系统上来部署与进行AI推理,因此,可以就近执行AI与深度学习推论模型,例如运用AI提供金融诈骗侦测与分析,或利用机器学习,加快银行贷款审核流程,还有处理高吞吐量的金融交易、反洗钱和风险分析等。

IBM Z产品管理资深副总Barry Baker在采访中称,虽然现今在银行一些交易处理已有结合AI防诈侦测机制,但受限于CPU运算能力,仅针对部分高价值、高风险交易来使用,通过Telum,就没有这个问题,可以对每笔交易进行侦测,确认所有交易都正常,防止漏网之鱼。

在如火如荼的AI计算市场上,英伟达凭借GPU(图形处理器)最先把握住了机会,成为AI企业几乎不可或缺的芯片供应商。此后,芯片大客户们更进一步,包括谷歌、阿里巴巴、亚马逊、华为等厂商,争相发布AI定制芯片,纷纷推出自研AI专用芯片,用于各项AI细分应用。

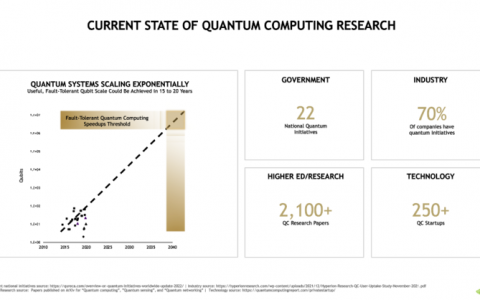

“在行业应用上,我们看到人工智能的工作负载越来越复杂,AI模型处理体量正在急剧增长,计算量需求越来越大、功耗越来越高的现状,试图从因此通过定制、专用的芯片来加速AI计算将是可行的。”一位IBM发言人告诉界面新闻 ,她还表示,自2017年以来,AI芯片的计算效率每年提高2.5倍,这为IBM的芯片开发设立了性能基准,“目标是在十年内继续将AI硬件计算效率每年提高2.5倍,到2029年实现1000倍的性能提升。”

本站部分文章来自互联网,文章版权归原作者所有。如有疑问请联系QQ:3164780!